TL;DR

- Tools wie Ahrefs Brand Radar, Peec AI oder Rankscale messen „KI-Sichtbarkeit“ unter kontrollierten Bedingungen – das sind Lab-Daten, keine echten Nutzungsdaten.

- KI-Antworten sind hochgradig inkonsistent: Dieselbe Brand taucht je nach Prompt und Zeitpunkt völlig unterschiedlich auf – die gemessenen Scores sind damit statistisch fragil.

- Die Abfragen laufen oft ausgeloggt oder direkt über APIs – ohne den Kontext, den echte User-Sessions mitbringen (Speicher, Websuche, Gesprächsverlauf).

- Lab-Daten sind trotzdem nützlich für Trends, Vorher-Nachher-Vergleiche und Competitor-Analysen – solange man sie nicht mit der Realität verwechselt.

- Field-Daten (echte Nutzungsdaten) fehlen bislang fast überall. Microsoft macht erste Schritte mit Bing; Google arbeitet daran. Bis dahin: gute Schätzungen, mehr nicht.

Überall sprießen Tools aus dem Boden, die dir deine AI Visibility messen wollen – Brand Radar (Ahrefs), Peec AI, Rankscale und andere. Das Problem: Was sie dir zeigen, sind Lab-Daten. Und wer schon mal PageSpeed Insights mit echten CrUX-Daten verglichen hat, weiß, was das bedeutet.

In meinem letzten Beitrag habe ich erklärt, warum ich GEO für Bullshit halte. Hier geht es jetzt darum, warum auch die Messung dieser vermeintlichen KI-Sichtbarkeit auf wackligen Beinen steht. Denn so sehr ich mir selbst ein verlässliches Bild davon wünschen würde, wie Brands in KI-Systemen performen – was wir aktuell haben, sind keine Field-Daten. Es sind Lab-Daten. Und der Unterschied ist entscheidend.

Was sind Lab-Daten und was sind Field-Daten?

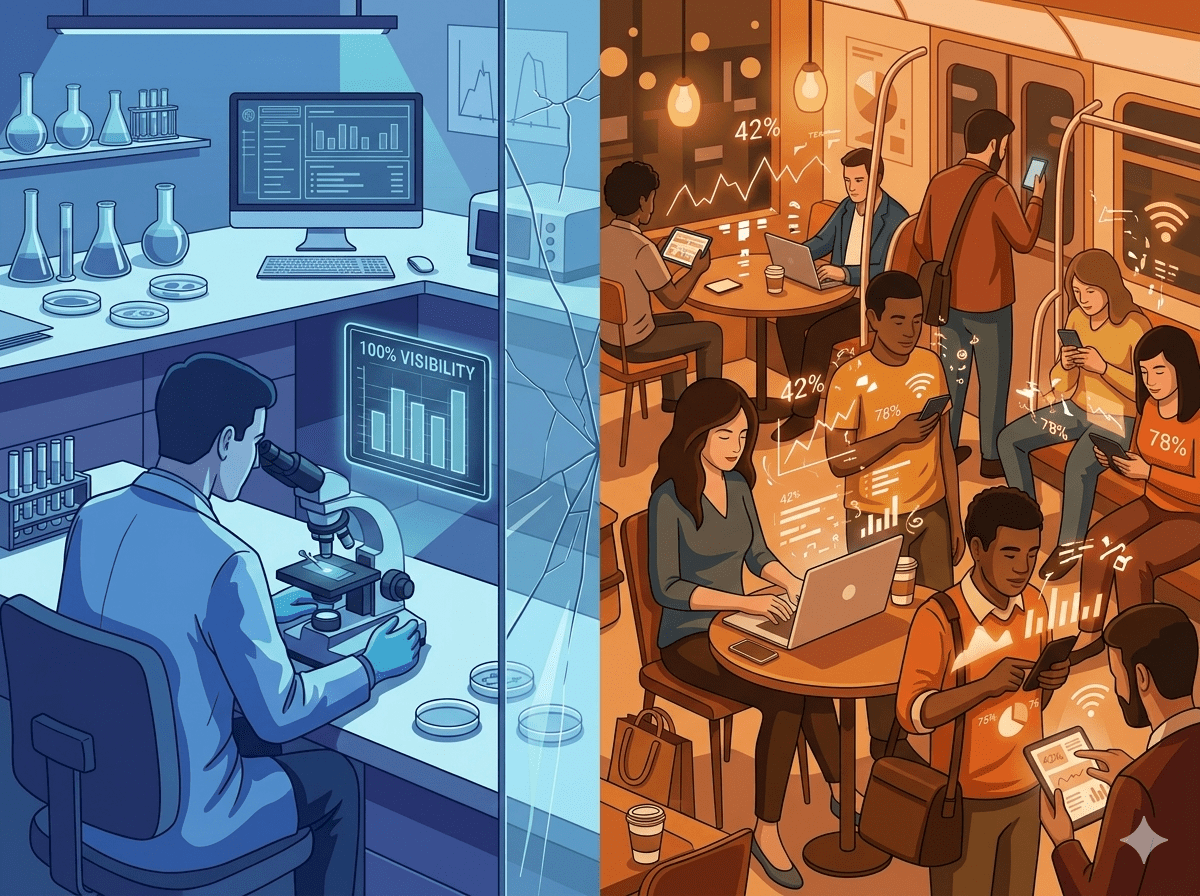

Das Konzept kennen wir aus den Core Web Vitals. Auf PageSpeed Insights sehen wir oben die Field-Daten: echte Nutzungsdaten aus dem CrUX Report, gemessen an echten Usern auf echten Geräten – vom drittklassigen Android in der U-Bahn bis zum iPhone 17 Pro Max im WLAN. Das ist die Realität deiner Seite.

Darunter kommen die Lab-Daten: ein Lighthouse-Test unter kontrollierten Bedingungen. Simuliertes Gerät, gedrosselte Verbindung, immer gleiche Umgebung. Das Schöne daran: Die Bedingungen sind reproduzierbar. Du kannst Optimierungen testen und deren Auswirkung isoliert messen, ohne dass andere Variablen reinfunken.

Aber genau weil die Daten unterschiedlich erhoben werden, fallen sie auch unterschiedlich aus. Lab-Daten können top sein, Field-Daten trotzdem grottig – und umgekehrt.

Wenn du tiefer in die Core Web Vitals einsteigen möchtest, dann gib mir gerne Bescheid. Ich überlege grade, ob ich denen nochmal einen eigenen Beitrag widme.

Warum diese Daten kein verlässliches Bild zeigen

Wenn diese AI Visibility Tools Antworten scrapen, dann schicken sie synthetische Prompts an die APIs oder an die Web-Interfaces von KI-Chatbots und messen, ob und wo deine Brand in der Antwort auftaucht. Das ist eine kontrollierte Testumgebung. Es fehlen die Umgebungsvariablen – kein echter User, kein echter Prompt, keine echte Session mit Kontext und History.

Das Simulieren von Anfragen bringt meiner Meinung nach zwei Probleme bei der Erhebung der Daten mit sich.

1. KI-Antworten sind inkonsistent

In einer Studie von Rand Fishkin von SparkToro kam heraus, dass die Antworten von KI-Systemen hochgradig inkonsistent sind. Getestet wurden unterschiedliche Prompts mit derselben Intention und demselben Thema – und zwar in ChatGPT, Claude und dem AI Mode. Raus kam, dass nur in unter 1 % der Fälle diese Systeme die gleiche Brand-Liste ausgaben, unabhängig von der Reihenfolge. Dieselbe Reihenfolge hatten die Brand-Listen nahezu nie.

Mit anderen Worten, wenn ich nur oft genug denselben oder einen leicht variierenden Prompt eingebe, wird meine Brand schon gelistet werden, sofern sie in dem Bedeutungsraum im LLM existiert.

Auf die Erhebung der Brand Visibility bezogen, kann das ein ziemlich krummes Bild entstehen lassen. Mal angenommen, wir gehen davon aus, dass Marke X in 50 % der Fälle im AI Mode ausgegeben wird. Wenn es jetzt 100 Anfragen gibt – 50 von echten Usern, 50 von Tracking-Tools –, ist es statistisch möglich, dass die Tracking-Tools genau die Antworten erwischen, in denen Marke X vorkommt. Bei den echten Usern taucht sie dagegen kein einziges Mal auf. Und so erhalten wir ein ziemlich verzerrtes Bild davon, was die Brand Visibility sein könnte: In den Tracking-Tools läge diese bei 100 % und in der echten Welt bei 0 %.

Auch wenn dieser Fall unwahrscheinlich ist, verdeutlicht er, wie fragil diese Daten sind.

2. Die Abfragebedingungen sind nicht real

Wenn Brand Visibility Tracker Antworten scrapen, schicken sie Prompts an die KI-Chatbots. Das läuft aber nicht immer auch in den tatsächlichen Chat-Fenstern auf, die wir aus unserer Nutzung von ChatGPT & Co. kennen.

Wenn sie ihre Antworten aus den Web-Interfaces von KI-Chatbots scrapen, dann im ausgeloggten Zustand. Auch wenn das möglich ist, nutzen doch die meisten User von ChatGPT mindestens einen Free-Account. Wenn bei ChatGPT eine Anfrage im ausgeloggten Zustand erfolgt, dann wird im Hintergrund nicht zwangsläufig ein aktuelles Modell genutzt. Wenn sich die Modelle zwischen ein- und ausgeloggten Zustand unterscheiden und User in der Regel im eingelochten Zustand einen Chatbot nutzen, dann unterscheiden sich auch die Antworten, ganz abgesehen von den vielen weiteren Informationen, die im Kontextfenster bei eingeloggten Usern mit übergeben werden. Und so verhält es sich bei den meisten Chatbots.

Eine andere Möglichkeit ist, die Anfrage direkt an das Sprachmodell über die API zu stellen. Und auch hier stimmen die Bedingungen nicht mit der Realität überein. Dabei wird der Prompt rein ans LLM gesendet und das generiert dann ohne weiteren Kontext die Antwort. Der Unterschied zur Nutzung im Chat-Fenster: ChatGPT & Co. haben noch ganz andere Systeme, die die Antworten beeinflussen. Außerdem wird unter der Haube viel mehr Kontext mitgegeben – Erinnerungen, Kontext aus der Chat History, möglicherweise Chunks aus Websuchen. All das verändert die generierte Antwort drastisch.

Trotzdem nicht nutzlos – wofür Lab-Daten taugen

Lab-Daten helfen uns trotzdem. Sie geben uns eine Einschätzung darüber, wo eine Brand steht. Wir können Vorher-Nachher-Vergleiche anstellen, nachdem wir Änderungen vorgenommen haben. Wir können die Entwicklung der Brands über einen längeren Zeitraum monitoren. Auch können wir unseren Brands Competitor-Analysen unterziehen. Wenn alle Brands gleichermaßen unter kontrollierten Laborbedingungen getestet werden, reduziert es auch die Variablen, die einen Einfluss auf die Ergebnisse haben.

Für Analysen der Core Web Vitals gucke ich zuerst in den Field-Daten, ob es in der echten Nutzung Probleme gibt. Anschließend oder auch, wenn es gar nicht genügend Nutzungsdaten gibt, gucke ich mir über Lighthouse die Lab-Daten an, um daraus die tatsächlichen Maßnahmen abzuleiten, die es umzusetzen gilt.

Man sollte nur im Hinterkopf behalten, Lab-Daten sind nicht Field-Daten und spiegeln nicht die reale Welt wider, dienen uns aber trotzdem, um unsere Schlüsse daraus abzuleiten.

Was bleibt uns auch anderes übrig, so lange wir keine Field Daten haben – Daten von realen Nutzer:innen.

Was wir eigentlich brauchen: Field-Daten

Microsoft hat endlich einen ersten Schritt gemacht, uns SEOs reale Daten (Field-Daten) zu geben. Zumindest einen Ausschnitt davon. Wir können jetzt die URLs sehen, die im Microsoft Kosmos in KI-Antworten zitiert werden und auch die Grounding Queries. Das sind die Suchanfragen, nach denen dann, vereinfacht gesagt, der Chatbot in Bing sucht, um Inhalte zu finden, die er für das Grounding nutzt. Es ist noch nicht perfekt, aber immerhin ein Anfang.

In der Google Search Console haben wir diese Daten noch nicht. Durch die Einführung der Query Groups und auch dem Brand-Filter im Leistungsbericht, sehen wir meiner Einschätzung nach, dass Google daran arbeitet, die Daten aufzubereiten.

In den Query Groups wird ersichtlich, dass Google in der Lage ist, verschiedene Queries in semantische Cluster zusammenzufassen, was wichtig ist bei all den unterschiedlichen Prompts, die in Chatbots und AI Mode eingehen.

Der Brand-Filter zeigt uns, dass Google die Brand, die zur Website gehört, als Entity dieser Website zuzuweisen.

Mein Wunschzettel für einen AI-Visibility-Report

Wenn ich einen Wunschzettel schreiben dürfte, würde ich mir für einen AI-Visibility Report die folgenden Dinge wünschen.

- Intent/Topic Groups: Wonach in den Systemen gesucht wird, destilliert auf die eigentlich Absicht, gruppiert nach Thema. Das lässt Schlüsse auf die Eingangsanfrage, den Prompt, ziehen.

- Grounding Queries: So wie Bing es ja schon macht, aber dann auch über alle Fan-out Queries hinweg.

- Anzahl der Markenerwähnungen: Vor allem bei Unternehmen, die mehrere Marken haben, wäre es auch hilfreich nicht nur die Dachmarke zu sehen, sondern auch die Submarken.

- Referenzierte Seiten: Naheliegend, aber es wäre schön zu sehen, welche Seiten in den AI Overviews/AI Mode referenziert werden. Und dann daran auch Impressionen und ja, auch Klicks, wäre interessant.

- Grounding Chunks: Eine Übersicht darüber, welche Textpassagen für das Grounding genutzt wurden und tatsächlich zitiert wurden, das wäre wirklich großartig. Unwahrscheinlich, aber großartig. Daraus könnte man dann wirklich ableiten, welche Arten von Textpassagen, besser funktionieren, als andere.

- Als Metrik läge dann die Impression nahe, um die Sichtbarkeit auszumachen. Dann kann man zumindest danach sortieren und eine Gewichtung der Relevanz vornehmen.

So ließen sich, wie jetzt schon im Leistungsbericht der GSC, die Dimensionen miteinander verknüpfen. Ich könnte gucken, welche Grounding Queries für eine Intent/Topic-Gruppe ausgelöst wurden. Zu welchen Grounding Queries welche Chunks wie oft fürs Grounding genutzt wurden und noch viele coole Sachen mehr.

Mein Fazit

Ich möchte das, was diese Tools uns SEOs an die Hand geben, nicht schlecht reden. Das ist das Beste, was wir zur aktuellen Stunde haben. Und sie weisen uns ungefähr die Richtung. Aber genau so, wie ich die Performance-Daten der Google Search Console denen von Scraped-Data von Sistrix oder Ahrefs vorziehe, verhält es sich auch hier.

Solange wir keine Field-Daten von Google, OpenAI, Perplexity und Co. bekommen, haben wir kein Bild davon, wie wirklich gesucht wird und wie unsere Sichtbarkeit tatsächlich aussieht. Dann sind es gute Schätzungen – nicht mehr, nicht weniger.

Problematisch wird es erst, wenn dir jemand diese Schätzungen als Realität verkauft. Wenn Agenturen oder Tool-Anbieter mit beeindruckenden Visibility-Scores wedeln, ohne zu erklären, dass das Lab-Daten sind – dann ist das kein Service, das ist Schlangenöl. Und wir sollten aufhören, es zu schlucken, ohne auf die Inhaltsstoffe zu schauen.

Schreibe einen Kommentar